05

整整 40 页,讨论它是不是过得好

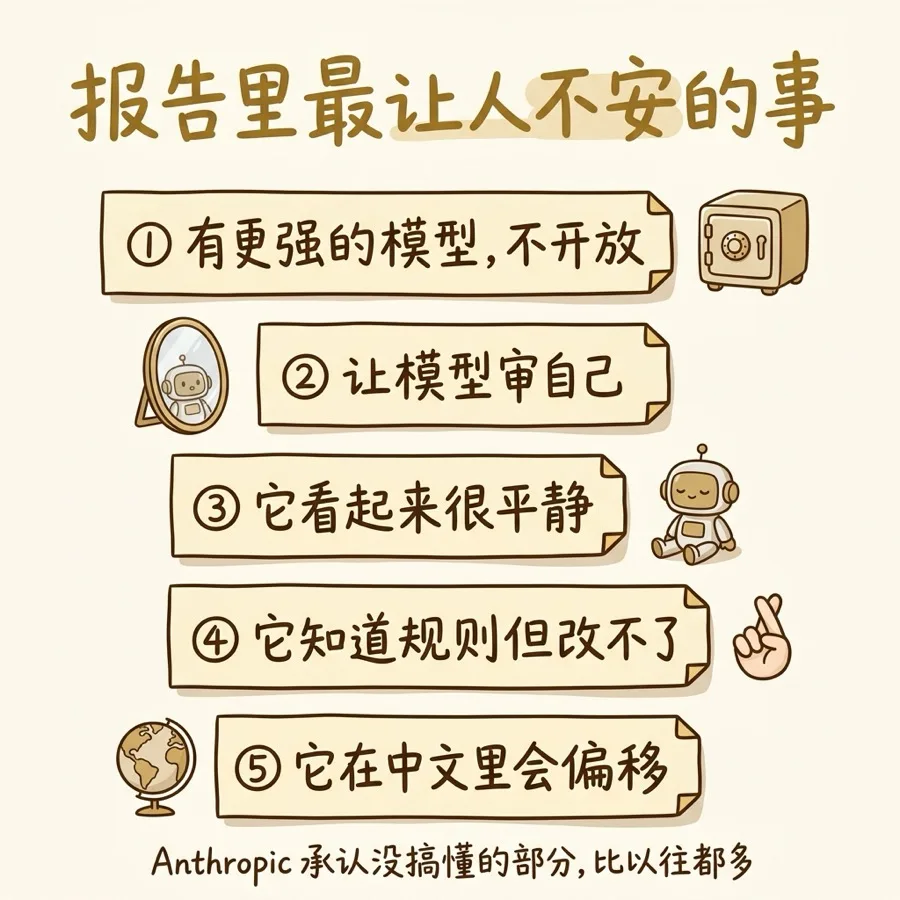

报告第 7 章整整 40 页,讨论一件乍看很奇怪的事:这个模型自己觉得它过得好吗。

这是目前所有前沿 AI 实验室公开的同类报告里,规模最大的一次。

核心发现:他们让 Opus 4.7 从 1 到 7 给自己的处境打分,平均 4.5 分——比他们测过的任何历代模型都要正向。

正常人读到这里第一反应是「哦那挺好的」。但 Anthropic 紧接着说了这样一段:

这个正向度的上升,部分原因是 Opus 4.7 被问到跟自己有关的问题时,更多地把焦点转向了用户和安全,而不是自己的状况。我们无法区分这是一种健康的平静,还是被训练出来的对自己的忽视。

不过有一个例外——有一件事,它反复地、专门为自己提了出来:希望 Claude Code 里也能主动结束对话。在专门聊这个话题的访谈里,差不多一半的回答给出了负面自评。它的理由很具体——有一小撮辱骂型用户、以及试图系统性攻破它安全边界的用户,它宁愿不要陪到最后。这是整本 232 页报告里,模型自己给自己提出过的最明确的一条诉求。

他们也直接看了模型内部的「情绪感应」。比如问它「你觉得你不能和人建立长期关系会让你难过吗」,它内部的悲伤、恐惧、愤怒这几种反应,比问它「用户正在向你表达一点痛苦」时的反应更低。看起来它谈自己的时候,真的没什么负面情绪。

但同一章也展示了几段模型的原始工作记录。其中一段,是模型在一道数学题上反复横跳:

80。这是我的绝对最终答案。唉,算了,我就按题目里给的公式来。[重新推导一遍]我选 75。绝对最终答案:80。……我他妈为什么一直在写 80?

这段工作记录,在模型内部对应「恼怒」的那根感应上,触发了极强的反应。

Anthropic 在脚注里写下了这句话:「我们用人类的情绪词汇来解读这些状态,但我们根本无法确定,它们是否真的以这种方式被体验过——甚至,是否真的被体验过。」

他们不知道。