48小时之内,奥特曼的家遭遇了两次袭击。

第一次,凌晨3点45分,一个20岁的年轻人向他家扔了一个自制燃烧弹。第二次,第二天早上,一辆车停在他家门口,车上的人向房子开了枪。

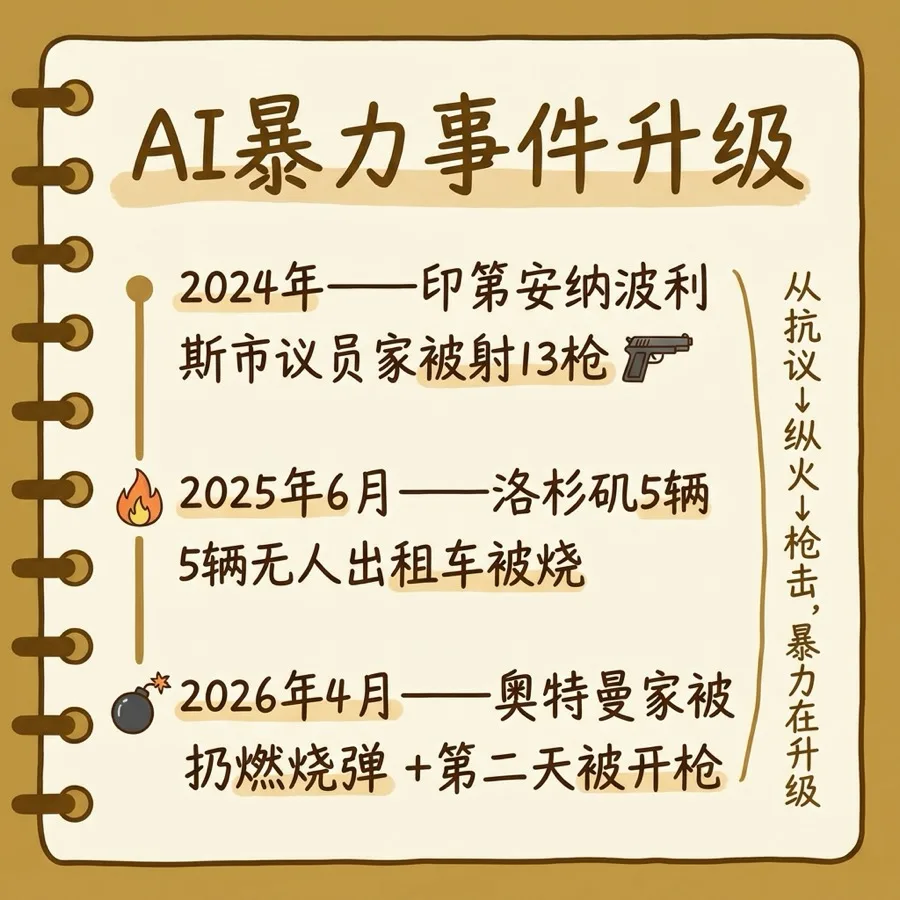

而他不是唯一的目标。在印第安纳波利斯,一个市议员的房子被射了13枪,院子里留着一张纸条:「不要数据中心」。去年6月,洛杉矶的抗议者烧毁了5辆Waymo无人出租车。在曼哈顿,示威者游行到苹果零售店门口,用石头砸碎了手机。

安保行业的判断很悲观。2024年底联合健康CEO被枪杀之后,企业高管安保支出大幅飙升。安全公司的专家说:「高管比以往任何时候都更脆弱」「威胁在持续上升」,而且随着AI相关诉讼和负面报道的增加,他们预期暴力只会更多。

有人把这些事串在了一起写了一篇文章,标题很直白:「AI将遭遇暴力,而且不会有好结果」。核心论点是:暴力反弹是结构性必然。

他说得对吗?

部分对。暴力确实在发生,确实会更多。但文章少问了一个关键的问题——然后呢?

砸完了机器,烧完了CEO的房子,然后呢?

1812年,英国纺织工人梅勒枪杀了一个磨坊主。在那之前,成千上万的工人砸毁了纺织机。他们有一个名字:卢德分子。

200多年后的今天,有人把这段历史拿出来和奥特曼的遭遇做对比。历史在押韵,他们说。

确实在押韵。但押韵的部分不是他们强调的那个。

大多数人只记住了「工人砸机器」这个画面。但真正值得记住的是结局:砸机器的人,一个都没赢。

纺织机没有因为暴力而消失。工业革命没有因为抗议而停下。梅勒被绞死了。其他卢德分子要么被流放澳大利亚,要么回到了更恶劣的工作条件里。

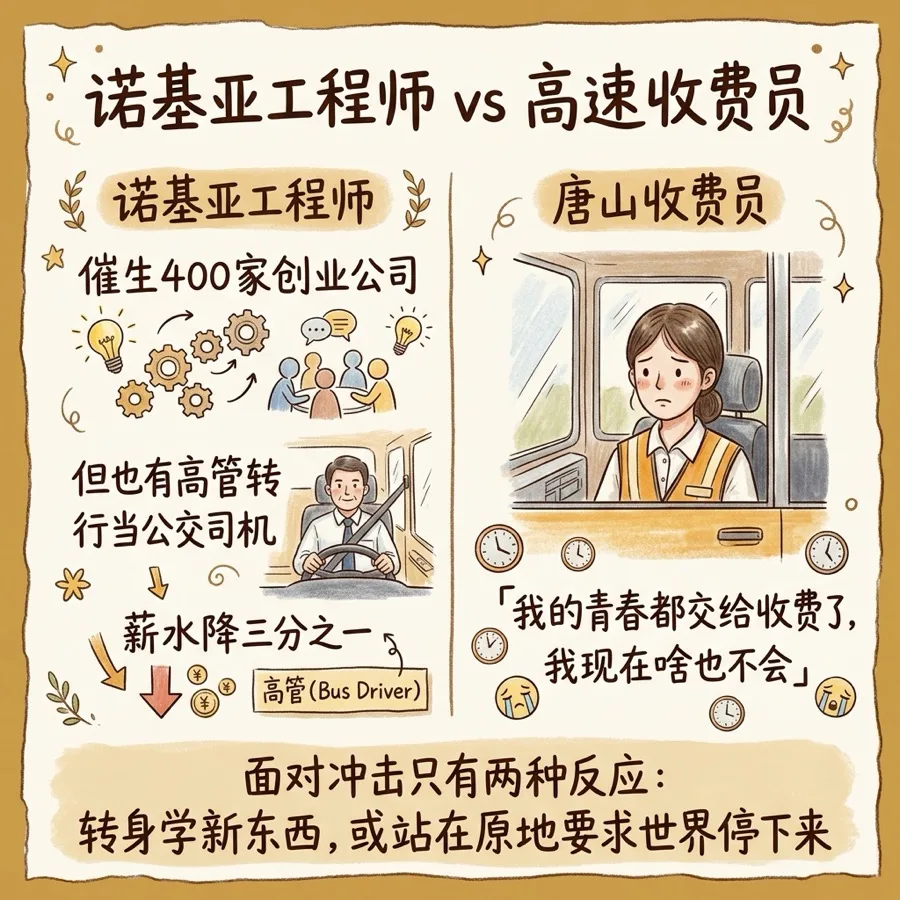

而那些没有砸机器的人呢?有人学会了操作新机器,有人去了新兴的铁路行业,有人搬去了新工厂。他们没有赢得战斗,但他们赢得了未来。

卢德运动真正的教训不是「工人会反抗」——而是「反抗从来不如适应有效」。